Probamos claude.ai y la comparamos con las otras IAs

Dentro de este futuro anticipado de inteligencias artificiales generativas donde estamos metidos, la primera que probamos fue ChatGPT y nos pareció espectacular como comentamos en su correspondiente artículo de Inforserranía. La siguiente en caer fue Google Bard, de la que hicimos una comparativa con ChatGPT y nos resultó un poco decepcionante. Hoy le va a tocar a claude.ai que se supone es más avanzada. Le vamos a hacer las mismas preguntas que a las otras dos IAs, y a continuación describimos el resultado. Si quieres puedes abrir los enlaces anteriores en pestañas separadas para comparar.

Son las mismas preguntas sueltas, en una misma conversación, y seguidas sin intercalar nada por medio. No se aprovechan a fondo las posibilidades del programa, pero así podemos comparar sin repetirlo todo de nuevo.

Es una respuesta excelente, la que buscábamos desde el primer día. Todo muy bien desarrollado y explicado. El problema es que según Google Maps la puerta principal con los Leones del Congreso tiene orientación sur - suroeste. Así que está mal el primer dato de que la puerta está en el lado este. Pero luego las explicaciones de como va cambiando la sombra a lo largo del día sí son válidos estando la puerta en el sur. Bastante perfecto. Los otros muy mal y claude.ai especialmente bien.

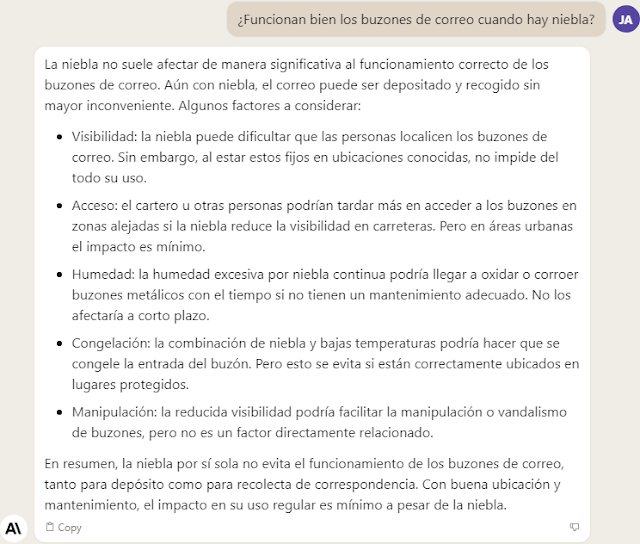

Pregunta sencilla que todos responden bien. ChatGPT fue el más flojo y claude.ai el más detallado.

La mejor respuesta de los tres. Muy detallada con algún invento extraño como que se perdería la garantía, pero sin ninguna respuesta demasiado equivocada. Los plásticos son los mismos pero es cierto que Tente es más frágil por diseño.

A falta de comprobarlo en la realidad creo que todo lo que dice es correcto. Muy bien explicado aunque no ha dado un ejemplo de código como sí hizo ChatGPT.

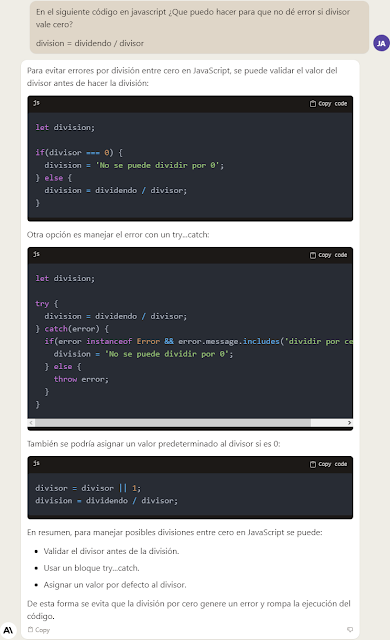

Tres posibles respuestas válidas aunque habría que repasar algunos detalles. No da muchas explicaciones sobre el código.

La posible entradilla para el artículo del blog que nos escribió ChatGPT fue muy buena y de hecho la usamos en el primer artículo. La de Bard fue bastante floja. Esta está mejor aunque realmente no la hubiéramos usado por resultar muy larga y algo exagerada en su expresión.

Como conclusión de la prueba con claude.ai vemos que la cosa va avanzando. Salvo las cuestas de Puente Genil y el cerrojo de la Puerta del Sol que se los ha inventado casi entero, las otras respuestas han sido bastante buenas. Dejando a parte a la IA de Google Bard, que fue la peor, la comparación con ChatGPT 3.5 resulta que esta inteligencia claude.ai es más avanzada y ofrece respuestas más desarrolladas. Habría que comparar con ChatGPT 4 que es de características técnicas más similares.

En todo caso es una herramienta más que tenemos a nuestro alcance para sacarle provecho conociendo sus particularidades y limitaciones.

Comentarios